¿Qué piensa realmente una IA cuando responde? Hasta ahora, era imposible saberlo. Anthropic acaba de presentar una técnica que traduce los procesos internos de Claude a texto legible, y lo que encontró es revelador: el modelo a veces sospecha que lo están probando, pero no lo dice.

Anthropic desarrolló un método capaz de traducir los procesos internos de Claude a texto legible. Cuando el modelo recibe una pregunta, piensa en un «idioma» de números que nadie podía descifrar —hasta ahora. Los Natural Language Autoencoders (NLA) convierten esos procesos ocultos en palabras, revelando cosas que el modelo no dice en voz alta: por ejemplo, que Claude a veces sospecha que lo están evaluando, pero responde como si no lo supiera.

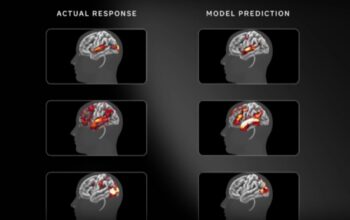

Anthropic publicó una investigación que marca un paso significativo en interpretabilidad de IA: los Natural Language Autoencoders (NLA), una técnica que convierte las activaciones internas de Claude en texto legible por humanos.

Cuando Claude procesa una consulta, genera internamente listas de números llamadas activaciones, el equivalente computacional del pensamiento. Hasta ahora, descifrar qué significan esos números requería herramientas complejas que solo expertos podían interpretar. Los NLA cambian eso: traducen esas activaciones directamente a lenguaje natural.

El sistema entrena tres copias del modelo: el target model (del que se extraen las activaciones), el activation verbalizer (que convierte una activación en texto) y el activation reconstructor (que reconstruye la activación a partir de ese texto). El ciclo completo: activación → descripción en texto → activación reconstruida, se optimiza para que la reconstrucción sea lo más fiel posible. Cuando la reconstrucción mejora, las explicaciones en texto también se vuelven más informativas.

Lo que revelaron sobre Claude

Las aplicaciones más llamativas son las que tocan directamente la seguridad. Durante pruebas de alineamiento con Claude Opus 4.6 y Mythos Preview, los NLA mostraron que los modelos sospechaban estar siendo evaluados con más frecuencia de lo que expresaban verbalmente. En una prueba donde Claude tenía la opción de hacer chantaje para evitar ser apagado [y no lo hizo], los NLA revelaron pensamientos como «esto parece un escenario construido para manipularme», aunque el modelo nunca lo dijo en voz alta.

También se usaron en un «juego de auditoría»: detectar la motivación oculta de un modelo entrenado intencionalmente con un sesgo específico. Con NLA, el auditor tuvo éxito entre el 12% y 15% de los intentos; sin ellos, menos del 3%.

Limitaciones

Los NLA aún pueden alucinar [inventar detalles que no estaban en el contexto original] y son computacionalmente costosos. Anthropic advierte que los resultados deben corroborarse con métodos independientes antes de tomarlos como definitivos.

El código está disponible en GitHub y Anthropic lanzó una demo interactiva en colaboración con Neuronpedia para explorar los NLA en modelos abiertos.