Mientras una parte de la investigación en inteligencia artificial intenta abrir la caja negra de los grandes modelos de lenguaje, otro campo avanza en sentido contrario: usar modelos de IA para entender, simular y predecir la actividad del cerebro humano.

Investigadores de FAIR, el laboratorio de inteligencia artificial de Meta, presentaron TRIBE v2, un modelo fundacional trimodal [capaz de procesar video, audio y lenguaje] diseñado para predecir respuestas cerebrales humanas medidas mediante resonancia magnética funcional, o fMRI, en distintos tipos de tareas y estímulos.

El estudio, titulado A foundation model of vision, audition, and language for in-silico neuroscience, plantea que la neurociencia cognitiva ha estado históricamente fragmentada en modelos especializados: unos para visión, otros para lenguaje, otros para sonido o para tareas experimentales muy concretas. TRIBE v2 busca integrar esos dominios en una arquitectura común, capaz de modelar actividad cerebral de alta resolución a partir de estímulos naturales y experimentales.

Para entrenarlo y evaluarlo, los investigadores reunieron más de 1,000 horas de registros fMRI correspondientes a 720 sujetos, expuestos a películas, podcasts, palabras aisladas, sonidos, imágenes y otros estímulos. Según el artículo, el modelo logró predecir respuestas cerebrales ante estímulos, tareas y sujetos nuevos, superando modelos lineales tradicionales usados en este tipo de análisis.

La idea no es menor: en lugar de observar únicamente qué zona del cerebro se activa ante un estímulo específico, TRIBE v2 intenta construir una especie de modelo digital predictivo del cerebro humano, capaz de anticipar patrones de actividad cortical cuando una persona mira, escucha o procesa lenguaje.

El hallazgo puede sonar a ciencia ficción, pero conviene ponerlo en su lugar. TRIBE v2 no lee pensamientos privados ni reconstruye directamente lo que una persona está imaginando. Su función es distinta: recibe estímulos, por ejemplo, video, audio o texto y predice cómo respondería el cerebro humano ante ellos, con base en patrones aprendidos de registros fMRI.

Aun así, el avance es inquietante porque desplaza la frontera de la neurociencia hacia modelos capaces de simular experimentos en computadora. Los autores señalan que TRIBE v2 permite realizar experimentación in silico, es decir, probar hipótesis sobre actividad cerebral mediante simulaciones antes o junto con experimentos en personas. En pruebas con paradigmas clásicos de visión y neurolingüística, el modelo recuperó resultados ya establecidos por décadas de investigación empírica.

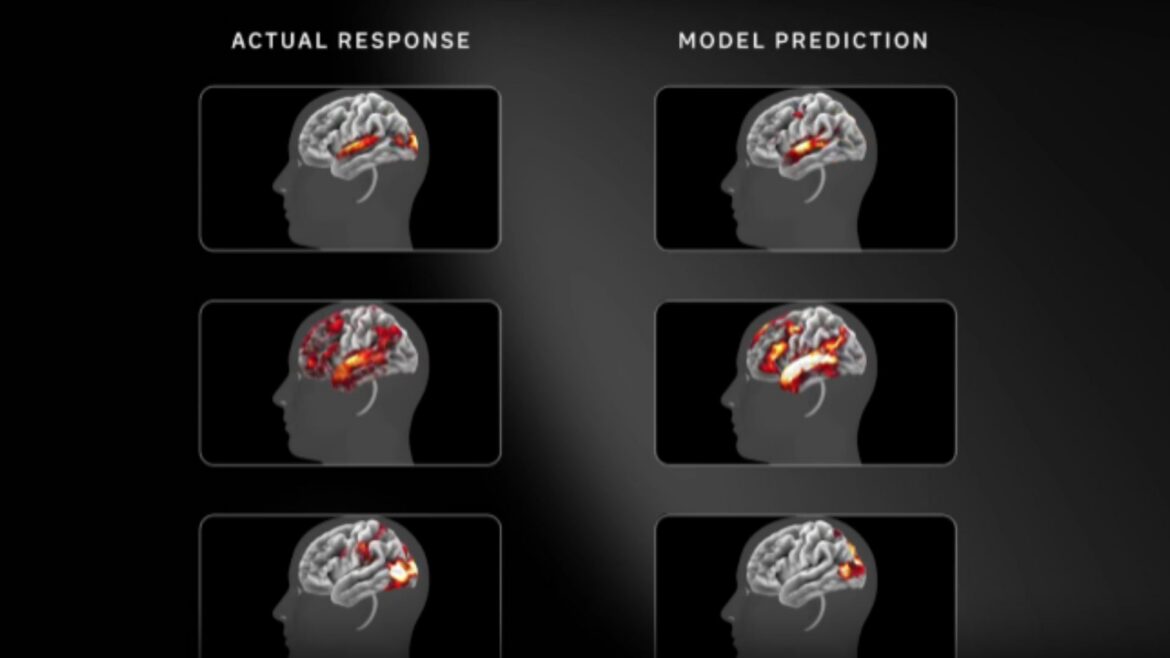

En el caso de visión, TRIBE v2 fue probado con estímulos diseñados para activar áreas conocidas del cerebro, como regiones relacionadas con rostros, lugares, cuerpos o caracteres escritos. El modelo produjo mapas de activación similares a los observados en experimentos reales, incluyendo áreas como la fusiform face area, asociada al procesamiento de rostros, y la visual word-form area, relacionada con el reconocimiento de caracteres escritos.

En lenguaje, el sistema también reprodujo patrones conocidos. Al analizar respuestas ante frases, sonidos, listas de palabras y construcciones lingüísticas más complejas, TRIBE v2 predijo actividad en regiones asociadas al procesamiento del lenguaje, como áreas auditivas, el surco temporal superior y regiones vinculadas a funciones semánticas y sintácticas.

La IA mira hacia adentro: de Claude al cerebro humano

El avance aparece en un momento especialmente llamativo para la investigación en inteligencia artificial. Mientras Anthropic ha mostrado métodos para interpretar estados internos de modelos como Claude —incluyendo casos en los que el sistema parece detectar que está siendo evaluado—, el trabajo de Meta apunta en dirección inversa: no se trata de leer el razonamiento de una IA, sino de usar IA para modelar respuestas del cerebro humano.

La coincidencia abre una frontera conceptual poderosa. Por un lado, los laboratorios buscan descifrar qué ocurre dentro de los modelos artificiales. Por otro, entrenan modelos capaces de aproximarse a la organización funcional del cerebro. En ambos casos, la pregunta de fondo es similar: ¿hasta qué punto puede una arquitectura artificial traducir procesos internos —humanos o maquínicos— en señales comprensibles?

TRIBE v2 también ofrece una lectura multimodal del cerebro. El estudio muestra que las modalidades de video, audio y texto contribuyen de manera distinta a la predicción de actividad cerebral: el audio domina en zonas auditivas, el video en regiones visuales, y el texto en áreas de lenguaje y partes del lóbulo prefrontal. La integración de esas tres modalidades mejora el modelado de la actividad cerebral completa, especialmente en zonas vinculadas con integración multisensorial.

Las limitaciones también importan

Los propios investigadores advierten que el modelo tiene límites relevantes. TRIBE v2 depende de datos fMRI, una técnica que no captura la dinámica neuronal en milisegundos. Además, sus entradas se limitan a visión, audio y lenguaje; quedan fuera otras modalidades sensoriales como olfato, equilibrio, tacto o señales corporales más complejas.

Otra limitación importante es que el modelo trata al cerebro como un observador pasivo de estímulos. Es decir, predice respuestas ante lo que una persona ve, escucha o lee, pero todavía no modela al cerebro como un agente activo que toma decisiones, actúa, modifica su entorno o produce conducta.

Ese matiz es clave para evitar exageraciones. TRIBE v2 no convierte a Meta en una empresa capaz de leer pensamientos humanos. Pero sí muestra que los modelos fundacionales empiezan a convertirse en herramientas para representar, simular y anticipar funciones cerebrales con una escala antes difícil de alcanzar.

Una nueva frontera para la neurociencia y la IA

El estudio plantea que la neurociencia podría estar entrando en una transición similar a la que vivieron otras áreas científicas con modelos fundacionales: pasar de estudios pequeños y aislados a sistemas capaces de integrar grandes cantidades de datos y generar predicciones sobre fenómenos complejos.

En ese sentido, TRIBE v2 no solo es un avance técnico. También es una señal de época: la inteligencia artificial ya no solo produce texto, imágenes o video; ahora empieza a participar en la construcción de modelos del cerebro humano.