El Gobierno de Donald Trump designó a Anthropic como un riesgo en la cadena de suministro después de que la empresa dirigida por Dario Almodei rechazó participar en acciones de vigilancia masiva contra ciudadanos estadounidenses y en el desarrollo de sistemas para desarrollar armas autónomas. Tras la ruptura, el Departamento de Guerra aceptó con OpenAI exactamente las mismas condiciones que le negó a Anthropic.

Dos de las empresas más influyentes en inteligencia artificialm, Anthropic y OpenAI, han respondido de forma radicalmente distinta a la presión del Departamento de Guerra de Estados Unidos. La tensión reveló un debate profundo sobre quién decide los límites éticos de la IA militar, y hasta dónde puede llegar el Estado para imponerlos.

El 27 de febrero de 2026, el secretario de Guerra Pete Hegseth anunció que instruiría al Departamento de Guerra para designar a Anthropic como un riesgo en la cadena de suministro, una categoría históricamente reservada para adversarios extranjeros de Estados Unidos. La razón: meses de negociaciones que colapsaron porque Anthropic se negó a ceder en dos puntos específicos.

This week, Anthropic delivered a master class in arrogance and betrayal as well as a textbook case of how not to do business with the United States Government or the Pentagon.

Our position has never wavered and will never waver: the Department of War must have full, unrestricted…

— Secretary of War Pete Hegseth (@SecWar) February 27, 2026

¿Cuáles? Que su modelo de IA, Claude, no sea utilizado para la vigilancia masiva de ciudadanos estadounidenses ni para el funcionamiento de armas completamente autónomas, es decir, sistemas capaces de decidir matar sin intervención humana.

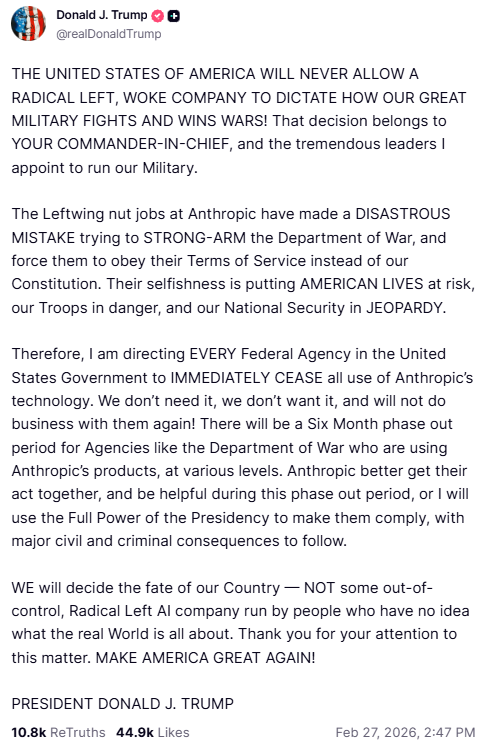

Un par de horas antes, el presidente estadounidense, Donald Trump, publicó en Truth Social un mensaje intimidatorio contra Anthropic, empresa a la que calificó como «radical de izquierda» y ordenó a las agencias de su país a cesar el uso de su tecnología de manera inmediata:

«Los izquierdistas desquiciados de Anthropic han cometido un ERROR DESASTROSO al intentar presionar al Departamento de Guerra y obligarlo a obedecer sus Términos de Servicio en lugar de nuestra Constitución. Su egoísmo está poniendo en riesgo VIDAS ESTADOUNIDENSES, a nuestras tropas y nuestra seguridad nacional.

«Por lo tanto, ordeno a TODAS las agencias federales del gobierno de los Estados Unidos que CESEN INMEDIATAMENTE el uso de la tecnología de Anthropic».

El pionero que dijo no

Hay una ironía que el comunicado de Dario Amodei, CEO de Anthropic, se encargó de subrayar desde el principio: su empresa no es un actor externo que el Pentágono intenta reclutar. Es, de hecho, la primera compañía de IA de frontera en desplegar sus modelos en las redes clasificadas del gobierno de Estados Unidos. Lo hizo antes que nadie en los Laboratorios Nacionales, antes que nadie con modelos personalizados para clientes de seguridad nacional. Claude, su IA, ya opera en misiones críticas: análisis de inteligencia, planificación operacional, ciberoperaciones, simulaciones.

Anthropic no es una empresa que se negó a entrar al mundo militar. Es una empresa que ya estaba adentro, y que aun así decidió trazar una línea.

Un día antes de la explosiva reacción de Trump, Amodei publicó una carta en la que explicó por qué las negociaciones con el Departamento de Guerra habían llegado a un punto de quiebre. Dos condiciones, sostuvo, nunca han formado parte de sus contratos y no deberían hacerlo ahora: que Claude sea utilizado para la vigilancia masiva de ciudadanos estadounidenses y para armas completamente autónomas, capaces de seleccionar y atacar objetivos sin intervención humana.

«El Departamento de Guerra ha declarado que solo contratará a empresas de inteligencia artificial que acepten «cualquier uso legal» y eliminen las salvaguardias en los casos mencionados. Han amenazado con eliminarnos de sus sistemas si mantenemos estas salvaguardias; también han amenazado con designarnos como un «riesgo para la cadena de suministro» (una etiqueta reservada para los adversarios de EE. UU., nunca antes aplicada a una empresa estadounidense) e invocar la Ley de Producción de Defensa para forzar la eliminación de las salvaguardias. Estas dos últimas amenazas son inherentemente contradictorias : una nos etiqueta como un riesgo para la seguridad; la otra, califica a Claude como esencial para la seguridad nacional.

«De todas formas, estas amenazas no cambian nuestra posición: no podemos, en conciencia, acceder a su petición», dijo Amodei en su carta pública.

Las dos líneas rojas y por qué importan

Amodei no enmarcó estas excepciones como caprichos corporativos sino como juicios técnicos y democráticos. En el caso de la vigilancia masiva, el argumento es que la IA permite ensamblar datos dispersos (movimientos, navegación web, asociaciones) en un retrato exhaustivo de cualquier persona, de manera automática y a escala masiva. Aunque esto sea actualmente legal en muchos casos, sostuvo Amodei, la ley sencillamente no ha alcanzado todavía a la tecnología.

En el caso de las armas autónomas, el argumento es más técnico pero igualmente contundente: los modelos de IA actuales no son suficientemente confiables. Usarlos para decidir cuándo y a quién matar pondría en riesgo tanto a combatientes como a civiles. Anthropic incluso ofreció colaborar con el Departamento de Guerra en investigación y desarrollo para mejorar esa confiabilidad. La oferta fue rechazada.

La respuesta del Departamento, en cambio, fue escalar la presión. Primero con amenazas de expulsión. Luego con la posibilidad de invocar la Ley de Producción para la Defensa, un mecanismo de tiempo de guerra, para forzar la eliminación de las salvaguardas. Y finalmente, el 27 de febrero, con el anuncio del secretario Pete Hegseth de designar a Anthropic como riesgo en la cadena de suministro, una categoría reservada históricamente para adversarios extranjeros.

Amodei señaló la contradicción en términos casi clínicos: uno de los argumentos del gobierno es que Anthropic es un riesgo de seguridad; el otro, que Claude es esencial para la seguridad nacional. Ambas cosas no pueden ser verdad al mismo tiempo.

OpenAI elige otro camino

Mientras Anthropic era amenazada por Trump, OpenAI, creadora de ChatGPT, anunció haber alcanzado un acuerdo con el Departamento de Guerra para desplegar sus modelos en redes clasificadas. Su CEO, Sam Altman, declaró que el acuerdo incluye los mismos principios que defiende Anthropic: prohibición de la vigilancia doméstica masiva y responsabilidad humana en el uso de la fuerza.

Altman también pidió que el gobierno ofrezca estos mismos términos a todas las empresas de IA. Y expresó su deseo de que la situación se aleje de acciones legales hacia acuerdos razonables, una frase que, en el contexto del conflicto con Anthropic, suena a algo más que una declaración de principios.

Tonight, we reached an agreement with the Department of War to deploy our models in their classified network.

In all of our interactions, the DoW displayed a deep respect for safety and a desire to partner to achieve the best possible outcome.

AI safety and wide distribution of…

— Sam Altman (@sama) February 28, 2026

¿Dos posturas, o dos umbrales?

La paradoja central de este episodio es que Anthropic y OpenAI dicen creer en lo mismo, pero una firmó y la otra no. Lo que no sabemos, porque los contratos son confidenciales, es si los términos reales son equivalentes, o si hay diferencias sustanciales en las garantías técnicas, los mecanismos de supervisión, o el alcance de lo que se considera «uso autónomo».

Lo que sí es visible es la diferencia de postura pública. Anthropic eligió la transparencia y el enfrentamiento; OpenAI eligió el acuerdo y la discreción. Ninguna de las dos decisiones es necesariamente incorrecta, pero revelan filosofías distintas sobre cómo una empresa de IA debe relacionarse con el poder del Estado en un momento de alta tensión geopolítica.

Lo que está en juego, más allá del Pentágono

El caso Anthropic vs. Departamento de Guerra es, en el fondo, una pregunta sobre gobernanza tecnológica que ninguna democracia ha resuelto todavía: ¿quién decide los límites éticos de la IA militar, y con qué mecanismos de rendición de cuentas?

Por ahora, esa negociación ocurre de manera privada, empresa por empresa, bajo presión gubernamental y sin participación ciudadana. El hecho de que sea una compañía privada, y no el Congreso, ni un organismo regulador, ni la ciudadanía, la que está sosteniendo la línea sobre vigilancia masiva y armas autónomas dice mucho sobre el estado actual de esa gobernanza.

Amodei lo dice con una honestidad poco común en el mundo corporativo: cree profundamente en la importancia de usar la IA para defender las democracias frente a sus adversarios autocráticos. Y precisamente por eso, dice, no puede entregarle herramientas que podrían corroer esa democracia desde adentro.

El debate, con toda su complejidad, acaba de volverse público. Y apenas comienza.