Una hipótesis técnica sobre la inteligencia artificial que no construimos, los monopolios fotográficos que pudieron haberla construido, y la industria que todavía podría.

El ingeniero abre la cámara de pruebas. Adentro, en una placa de silicio del tamaño de una uña, hay un interferómetro de Mach-Zehnder. No hay transistores. No hay electrones moviéndose. Hay luz (un haz láser dividido en dos caminos, recombinado) y en la diferencia de fase entre esos dos caminos está codificada la respuesta a una multiplicación matricial que un GPU tardaría diez veces más en calcular. El chip no genera calor perceptible. El ingeniero anota en su libreta: esto ya funcionaba en 1993. Nadie le hizo caso.

I. El problema que nadie quiere admitir

La inteligencia artificial tiene un problema de física. No de algoritmos, no de datos, no de talento humano: de física fundamental. Los modelos de lenguaje y visión que han transformado la industria tecnológica en los últimos años consumen energía a una escala que empieza a resultar geológica.

Según McKinsey, la demanda global de capacidad de centros de datos podría crecer de 82 a 219 gigawatts entre 2025 y 2030. Dentro de ese total, las cargas de IA representarían 156 gigawatts hacia el final de la década. El gasto de capital asociado solo a infraestructura para IA se estima en 5.2 billones de dólares

El cuello de botella no es el software. Es el hardware. Y el hardware tiene un límite que los físicos conocen desde hace décadas: los electrones generan calor (Efecto Joule) cuando viajan por materiales. Cuanto más rápido se procesan, más calor. Cuanto más calor, más energía necesaria para enfriarlo. La Ley de Moore, que supone que la duplicación aproximada de transistores por chip ocurre cada dos años, se está frenando no porque los ingenieros sean menos creativos, sino porque la física de los electrones en materiales conductores tiene un piso que no se puede perforar con más inversión.

II. Lo que la luz puede hacer que el electrón no puede

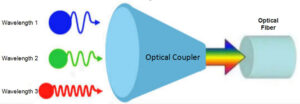

Un fotón no tiene masa. Puede interactuar y provocar calor al chocar con la materia. Puede transportar múltiples señales simultáneamente usando diferentes longitudes de onda, un principio llamado multiplexación por división de longitud de onda que la industria de telecomunicaciones usa desde los años noventa en fibra óptica. Y para la operación que es el corazón computacional de la inteligencia artificial (la multiplicación de matrices) la óptica tiene una propiedad casi insultante en su elegancia: puede realizarla mediante interferencia luminosa, de manera casi instantánea, con un consumo energético menor que el silicio electrónico convencional.

La computación fotónica no es ciencia ficción. Es un campo con décadas de historia: ya en 1993 existían demostraciones de reconocimiento facial mediante redes ópticas, y en 2024 y 2025 varios trabajos publicados en Science, Nature Photonics y Nature Communications reportaron avances importantes en eficiencia, procesamiento tensorial y precisión.

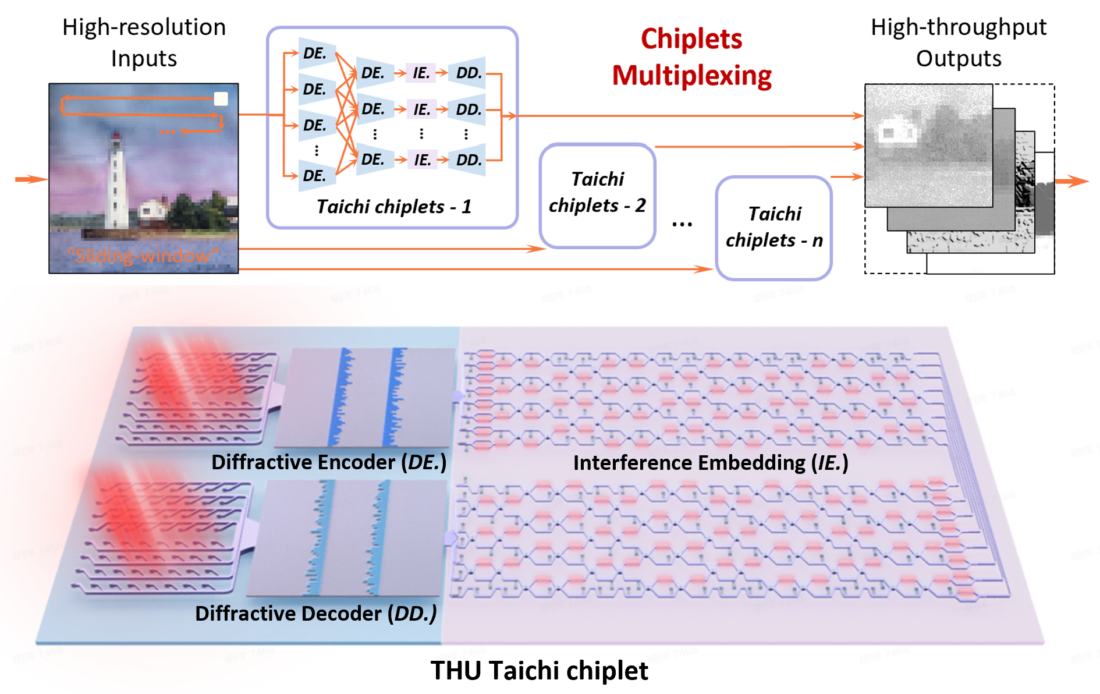

En 2024, investigadores de la Universidad de Tsinghua publicaron en Science el chip fotónico Taichi, alcanzando 160 TOPS/W (billones de operaciones por segundo por vatio) en tareas de inteligencia artificial general. En noviembre de 2025, investigadores de Aalto University y socios chinos demostraron procesamiento tensorial completamente paralelo mediante una única propagación de luz coherente, realizando las mismas operaciones que los núcleos tensoriales de un GPU pero, en palabras de sus autores, ‘a la velocidad de la luz’.

El obstáculo real no es que la luz no pueda computar. Es que los fotones no interactúan fácilmente entre sí, lo que hace muy difícil construir el equivalente óptico de un transistor, un interruptor que controle un haz de luz con otro haz de luz. Sin esa capacidad de conmutación no-lineal, la computación fotónica queda confinada principalmente a inferencia: ejecutar modelos ya entrenados, no entrenarlos. Útil, pero incompleto.

Sin embargo, el campo avanza. En agosto de 2025, Nature Communications publicó una arquitectura híbrida digital-analógica que alcanza 16 bits de precisión en procesamiento fotónico, eliminando uno de los obstáculos históricos. La pregunta ya no es si la computación fotónica puede funcionar. La pregunta es por qué lleva más de treinta años funcionando a escala de laboratorio sin convertirse en industria.

III. La industria que tenía todo para hacerlo

En algún momento entre 1970 y 1995, existía en el planeta un conjunto de empresas con exactamente el conocimiento necesario para construir la computación fotónica como industria. No lo hicieron. Esto es lo que tenían:

Nikon, Canon, Leica, Zeiss y sus contemporáneas habían llevado la manufactura óptica de precisión a un nivel de perfeccionismo. Fabricar un objetivo fotográfico de alta gama requería pulir superficies con tolerancias de fracciones de micrómetro, depositar recubrimientos antirreflectantes de pocas moléculas de espesor, y alinear conjuntos de elementos con precisión de décimas de milímetro.

Ese conocimiento es exactamente lo que se necesita para construir circuitos fotónicos integrados. Un interferómetro de Mach-Zehnder (el elemento básico de la computación fotónica) es, en esencia, un problema de óptica de precisión: dividir un haz, enviarlo por dos caminos con diferente longitud, recombinarlo y medir la interferencia. Las empresas fotográficas hacían algo estructuralmente equivalente cada vez que fabricaban un objetivo con varios elementos de vidrio.

Además, estas empresas tenían una relación íntima con el problema del registro de información en luz. Los sensores CCD (inventados en Bell Laboratories en 1969 por Willard Boyle y George Smith, trabajo que les valió el Nobel en 2009) se basan en el efecto fotoeléctrico: materiales que liberan electrones cuando los golpea la luz. Las empresas fotográficas adoptaron y desarrollaron esta tecnología durante décadas. Tenían físicos, tenían ingenieros de materiales, tenían la infraestructura de manufactura de precisión.

Y sin embargo, cuando llegó el momento de decidir dónde invertir el capital y el talento para el siguiente ciclo tecnológico, la industria fotográfica no apostó por la computación fotónica. Apostó por digitalizar la fotografía. Y luego vio cómo esa apuesta la hacía casi obsoleta en menos de una generación.

IV. Nikon: la apuesta silenciosa

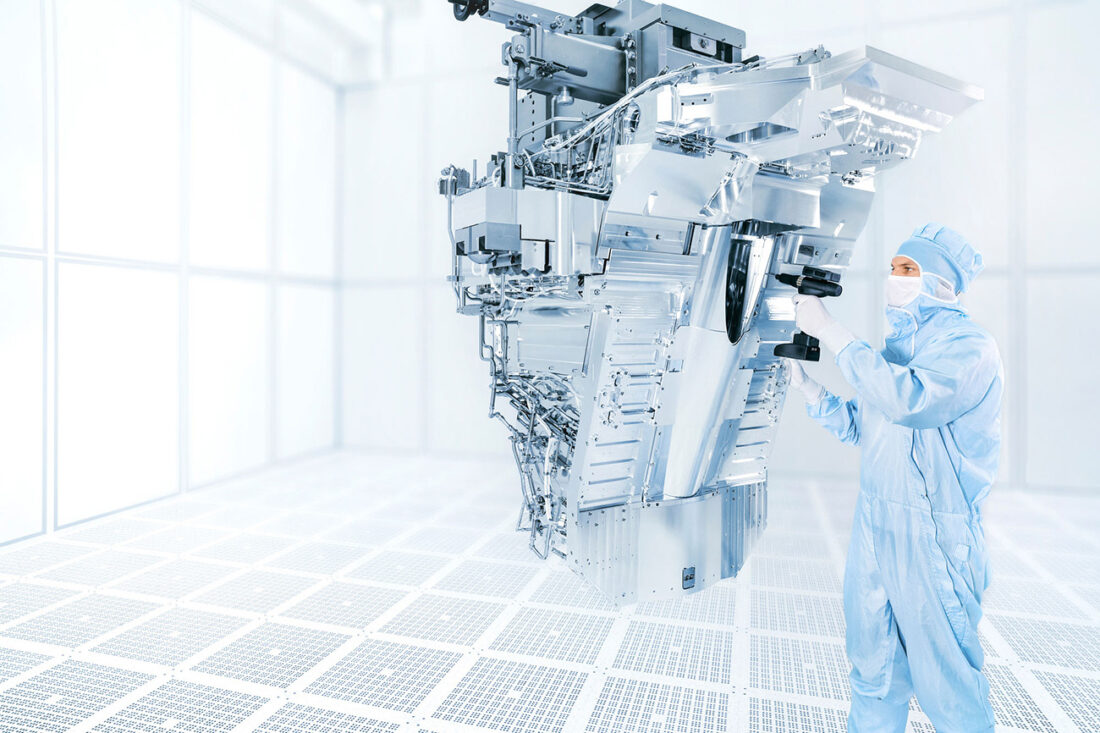

En la narrativa convencional sobre los semiconductores, Nikon aparece como la empresa que perdió frente a ASML en la carrera por la litografía ultravioleta extrema. La historia más citada señala que Nikon pausó su desarrollo EUV alrededor de 2009 y dejó el campo libre a su competidor holandés.

Esa narrativa es incompleta. Nikon sigue activa en litografía de semiconductores con una estrategia técnicamente distinta. En lugar de EUV (que usa luz con longitud de onda de 13.5 nanómetros generada disparando un láser a gotitas de estaño fundido 50,000 veces por segundo) Nikon desarrolló y perfeccionó la litografía por inmersión: llenar el espacio entre la lente de proyección y el wafer con agua purificada, cuyo índice de refracción más alto (1.44 versus 1.00 del aire) permite aumentar la resolución efectiva hasta 38 nanómetros o menos. Combinada con técnicas de patterning múltiple, esta tecnología produce procesos de nodo por debajo de 10 nanómetros.

Lo que hace la posición de Nikon interesante en el contexto de este análisis no es la carrera contra ASML. Es lo que implica sobre el conocimiento acumulado. Una empresa que lleva décadas resolviendo problemas de óptica de precisión a escala nanométrica, que fabrica los sistemas con los que se producen los chips de los dispositivos móviles más vendidos del mundo, que tiene una historia que va directamente de las lentes fotográficas del siglo XX a la litografía de semiconductores del siglo XXI, está posicionada de manera única para entender qué hace falta para que la computación fotónica funcione a escala industrial.

Si alguna empresa heredera de la industria fotográfica tiene el perfil técnico para cerrar la brecha entre los resultados de laboratorio en computación fotónica y la manufactura en volumen, Nikon es un candidato no obvio pero coherente.

V. Carl Zeiss y la continuidad del conocimiento

La historia más reveladora sobre cómo el conocimiento óptico migra entre industrias no está en Nikon. Está en Carl Zeiss.

La empresa fundada en Jena en 1846, cuya colaboración con el físico Ernst Abbe transformó la fabricación de lentes en ciencia de precisión, terminó siendo el proveedor irremplazable de la pieza más crítica de la cadena de fabricación de semiconductores moderna. Los espejos que dirigen la luz ultravioleta extrema dentro de las máquinas de ASML son fabricados exclusivamente por Carl Zeiss SMT. Son los objetos más lisos que la humanidad ha construido: si uno de esos espejos se escalara al tamaño de Alemania, la imperfección más grande sería menor a un milímetro. En 2016, ASML invirtió mil millones de dólares directamente en Zeiss para garantizar ese suministro.

El conocimiento que permite fabricar esos espejos no es distinto en su naturaleza del conocimiento que permitía fabricar las mejores lentes fotográficas del siglo XX. Es el mismo dominio llevado a su límite físico posible: entender cómo se comporta la luz al interactuar con superficies materiales, y producir esas superficies con la máxima precisión alcanzable.

Esto sugiere algo importante para el futuro de la computación fotónica: el conocimiento tácito que hace falta para convertirla en industria no es radicalmente nuevo. Existe, concentrado en pocas empresas europeas y japonesas con raíces en la manufactura óptica del siglo anterior. La pregunta no es si ese conocimiento puede aplicarse a la fabricación de circuitos fotónicos integrados. La pregunta es si existe la voluntad estratégica y el capital para intentarlo.

VI. Una línea industrial perdida que todavía puede abrirse

Lo que sigue es una hipótesis compuesta. Sus partes verificables están señaladas como tales. Sus partes especulativas son inferencias a partir de los hechos.

Verificable: La computación fotónica puede realizar multiplicaciones matriciales, el cálculo central de las redes neuronales, con ventajas teóricas en velocidad y eficiencia energética frente al silicio electrónico. Hay resultados publicados en revistas científicas de primer nivel que lo demuestran.

El principal obstáculo técnico de la computación fotónica —la conmutación no-lineal, equivalente al transistor— no está resuelto a escala industrial. Los sistemas fotónicos actuales son más útiles para inferencia que para entrenamiento.

Las empresas con más conocimiento acumulado en óptica de precisión a escala nanométrica son herederas directas de la industria fotográfica del siglo XX. Carl Zeiss, Nikon, y en menor medida Canon tienen décadas de experiencia manufacturera directamente aplicable a la fabricación de circuitos fotónicos integrados.

Especulativo: Si en los años ochenta alguna de estas empresas hubiera apostado por la computación fotónica con la misma determinación con que ASML apostó por EUV (y con financiamiento equivalente de sus clientes potenciales) la industria de la inteligencia artificial podría estar construida hoy sobre una arquitectura fotónica en lugar de electrónica. Los modelos de lenguaje no estarían limitados por la generación de calor de los transistores. El costo energético del entrenamiento sería estructuralmente diferente.

La ventana para que eso ocurra no está cerrada. Está entreabierta. La computación fotónica no tiene todavía un ASML: una empresa que haya apostado todo por ese camino y acumulado décadas de ventaja. El campo sigue fragmentado entre startups como Lightmatter y grupos de investigación académica. El conocimiento manufacturero que haría falta para industrializarlo a escala existe, pero está en empresas que todavía no han apostado por esta aplicación específica.

La pregunta no es técnica. Es estratégica. ¿Quién va a ser el ASML de la computación fotónica?

VII. Por qué importa ahora

La urgencia no es abstracta. La demanda energética de la inteligencia artificial está creciendo más rápido que la eficiencia de los chips electrónicos. El paradigma dominante (más transistores, más pequeños, más rápidos) tiene un límite físico que se acerca. La industria lo sabe. Por eso NVIDIA, Google, Intel y docenas de startups están invirtiendo en alternativas: chips de memoria in-processing, arquitecturas neuromórficas, y sí, computación fotónica.

Pero hay algo que distingue la computación fotónica de las demás alternativas: requiere un tipo de conocimiento manufacturero que no se desarrolla en Silicon Valley. Requiere décadas de experiencia trabajando con luz a escala nanométrica. Requiere el tipo de artesanía industrial que describía el conocimiento óptico de Zeiss o Nikon como algo que no se replica con dinero en poco tiempo.

La ironía histórica es que las empresas mejor posicionadas para liderar esa transición son herederas de una industria (la fotografía analógica) que la narrativa tecnológica convencional considera un caso de fracaso ante la disrupción digital. Kodak como símbolo de empresa que no supo adaptarse. Nikon como perdedora frente a los smartphones.

Esa narrativa ignora que el conocimiento óptico de precisión que esas empresas acumularon no desapareció con el negativo fotográfico. Migró, se transformó, y se convirtió en el cimiento invisible de la computación moderna. Y podría, si alguien toma la decisión correcta en el momento correcto, convertirse también en el cimiento de la computación del futuro.

El ingeniero que imaginamos al principio no existe todavía. Pero el chip que tiene en sus manos ya existe en laboratorio. La distancia entre el laboratorio y la fábrica es, en este caso, la misma distancia que separa una decisión estratégica de una industria transformada.