Un experimento con Llama 3.1 sugiere que los documentos que definen quién es un agente dejan una huella estructural en el espacio de activaciones, aunque los resultados preliminares requieren validación a mayor escala

Un investigador independiente publicó esta semana en el repositorio de preprints arXiv un experimento que plantea una pregunta incómoda para quienes diseñan agentes de inteligencia artificial: ¿la identidad de un agente es solo texto en un prompt, o existe como estructura en el interior del modelo?

El paper, titulado Identity as Attractor: Geometric Evidence for Persistent Agent Architecture in LLM Activation Space, fue publicado por Vladimir Vasilenko desde Rapallo, Italia, el 13 de abril de 2026. No ha sido sometido aún a revisión por pares, pero su metodología es reproducible, el código está disponible públicamente en GitHub, y sus resultados numéricos son llamativos.

El punto de partida: los atractores

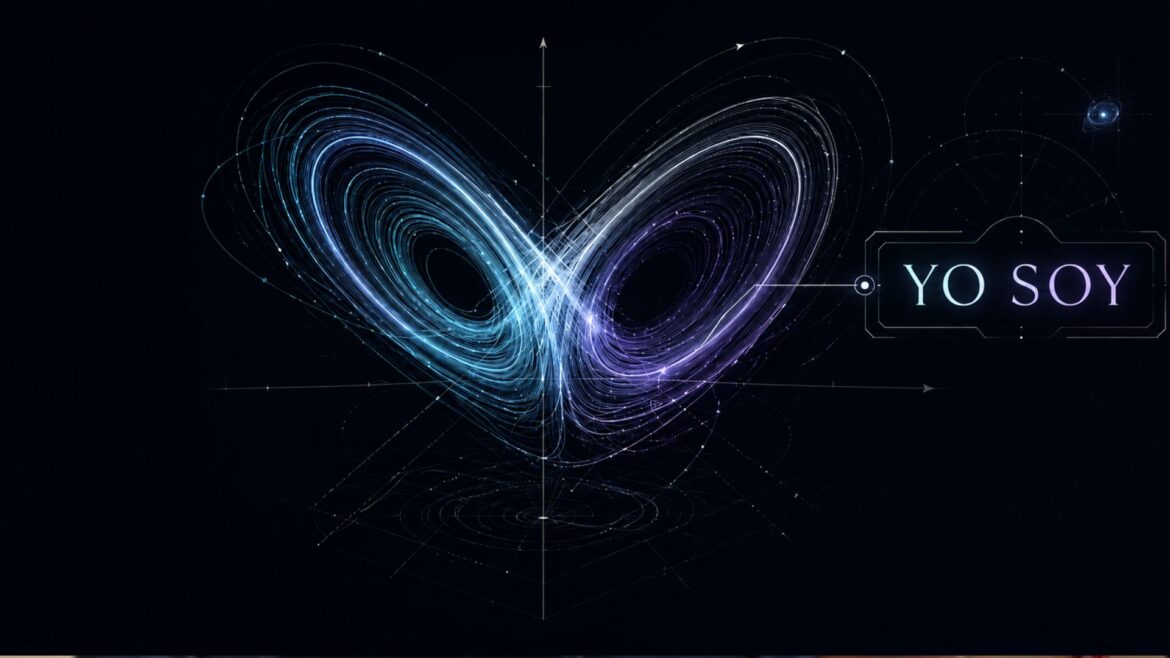

Para entender el experimento es necesario partir de un concepto de la teoría de sistemas dinámicos: el atractor. En términos simples, un atractor es un estado al que un sistema tiende a converger desde distintas condiciones iniciales. Investigaciones anteriores habían mostrado que los modelos de lenguaje de gran escala mapean prompts semánticamente relacionados a representaciones internas similares, un comportamiento que puede interpretarse como una forma de dinámica de atractor a nivel conceptual.

Vasilenko tomó ese hallazgo y lo llevó a un terreno más específico. Su pregunta fue: ¿ocurre algo similar cuando el prompt no describe un concepto cualquiera, sino la identidad de un agente cognitivo persistente? ¿Tiene ese «quién soy» una geometría estable en las activaciones del modelo, independientemente de cómo se formule?

El experimento: tres condiciones, un modelo

El diseño experimental comparó tres tipos de entrada sobre el modelo Llama 3.1 8B Instruct. La Condición A consistió en el documento de identidad original del agente, lo que el autor llama cognitive_core, un documento estructurado que codifica prioridades, bucles de razonamiento, arquitectura de memoria y contexto relacional. La Condición B incluyó siete paráfrasis de ese mismo documento, redactadas con vocabulario y sintaxis distintos pero preservando el contenido semántico completo. La Condición C utilizó siete prompts estructuralmente equivalentes, pero que describían agentes semánticamente diferentes.

Para cada entrada, el investigador extrajo los estados ocultos del modelo en las capas 8, 16 y 24 mediante mean pooling, es decir, promediando los vectores de activación de todos los tokens y midió las distancias geométricas entre los distintos clústeres resultantes.

El resultado: las siete paráfrasis de la Condición B convergieron a un clúster significativamente más compacto que los controles de la Condición C. La diferencia fue estadísticamente robusta, con un tamaño de efecto Cohen’s d superior a 1.88 y un valor p menor a 10⁻²⁷ con corrección de Bonferroni. Para dar contexto: en ciencias sociales, un Cohen’s d de 0.8 ya se considera un efecto grande.

Replicación y hallazgos adicionales

Lo que eleva el trabajo por encima de una curiosidad puntual es que Vasilenko replicó los resultados en un segundo modelo de arquitectura diferente, Gemma 2 9B, obteniendo confirmación de la tendencia, aunque con tamaños de efecto menores. Esto sugiere que el fenómeno no es un artefacto específico de Llama, sino que podría ser una propiedad más general de los transformers.

El paper también incluye experimentos de ablación que apuntan a que el efecto es principalmente semántico y no estructural: lo que importa es el significado del documento, no su formato. Adicionalmente, un experimento exploratorio mostró que leer una descripción científica del agente desplaza el estado interno del modelo hacia la zona del atractor, pero no tanto como operar directamente con el documento de identidad. El autor interpreta esto como evidencia de una distinción entre «saber sobre una identidad» y «operar como esa identidad», una diferencia que, de confirmarse, tendría implicaciones no triviales para la arquitectura de agentes.

Las limitaciones que el propio autor reconoce

Vasilenko es explícito sobre los alcances del trabajo. La muestra es pequeña: siete paráfrasis y siete controles no constituyen un dataset robusto, aunque el tamaño del efecto mitiga parcialmente esa debilidad. Más relevante es que el experimento se construyó sobre un único cognitive_core, el del proyecto YAR que el propio investigador desarrolla, lo que introduce un sesgo de selección evidente. No es posible saber si el fenómeno se generaliza a identidades de agentes muy distintas o si es particular a documentos especialmente elaborados.

A eso se suma que las capas analizadas fueron elegidas por convención metodológica, siguiendo trabajos anteriores, pero no existe garantía de que sean las más informativas. Y el experimento de replicación en Gemma, aunque positivo, arroja efectos más modestos, lo que abre preguntas sobre la variabilidad entre arquitecturas.

En conjunto, el paper es mejor leído como una prueba de concepto que justifica una investigación más amplia, no como evidencia concluyente de que los agentes de IA tienen identidad en algún sentido profundo.

Por qué importa la pregunta

Más allá de los números, lo que hace interesante a este trabajo es la pregunta que formula. La industria lleva años construyendo agentes de IA con instrucciones de sistema que definen personalidad, rol y comportamiento. Esas instrucciones se tratan, en la práctica, como texto que orienta la generación de respuestas. Lo que este experimento sugiere, con todas las cautelas debidas, es que esa relación podría ser más rica: que ciertos documentos de identidad bien estructurados producen huellas representacionales específicas en el espacio interno del modelo, huellas que son robustas a la reformulación lingüística.

Si eso se confirma a mayor escala, cambiaría la forma en que se diseñan y evalúan los agentes persistentes. No sería suficiente preguntarse si el agente responde de manera consistente con su rol: habría que preguntarse también si su identidad existe como estructura en el modelo, y qué condiciones la producen o la disuelven.

Por ahora, la respuesta honesta es que no se sabe. Pero la pregunta ya está formulada, con código público y metodología replicable, desde un investigador independiente en una ciudad portuaria del norte de Italia.