Un reporte del Financial Times señala que trabajadores de Amazon usaron una herramienta interna para generar consumo artificial de tokens. El caso abre una discusión más amplia: la IA todavía se usa por debajo de su capacidad técnica, pero algunas empresas ya la miden como señal de transformación laboral.

Empleados de Amazon habrían usado una herramienta interna de inteligencia artificial para automatizar tareas innecesarias y elevar sus métricas de consumo de tokens, según un reporte publicado este martes por el Financial Times. La práctica, descrita como “tokenmaxxing”, ocurrió en medio de la presión corporativa para aumentar el uso de IA dentro de la compañía.

De acuerdo con el diario británico, Amazon comenzó a desplegar en semanas recientes una herramienta llamada MeshClaw, que permite a empleados crear agentes de IA conectados a software de trabajo para ejecutar acciones en nombre del usuario. El reporte señala que la empresa fijó objetivos para que más de 80% de sus desarrolladores usaran IA cada semana y empezó a rastrear el consumo de tokens en tableros internos.

Amazon sostuvo que esas estadísticas no serían utilizadas en evaluaciones de desempeño. Sin embargo, empleados citados por el reporte expresaron preocupación por la forma en que las métricas podrían ser observadas por managers y por los incentivos que generan dentro de la organización.

La IA puede estar subutilizada frente a sus capacidades técnicas. Algunas empresas pueden estar sobrerreportando o inflando señales internas de adopción al convertir el uso de IA en una métrica visible.El caso también sugiere que la adopción de IA podría heredar prácticas laborales previas de simulación y manipulación de indicadores. En distintos entornos corporativos, los trabajadores han aprendido a responder a sistemas de medición produciendo señales de cumplimiento, aunque esas señales no siempre correspondan con mejoras reales de productividad. Si el uso de IA se convierte en una métrica interna, el riesgo es que las estadísticas de adopción terminen mezclando usos genuinos con conductas orientadas a satisfacer el indicador. Esto podría dificultar, a largo plazo, distinguir entre integración real de IA y actividad generada para cumplir expectativas organizacionales.

Adopción irregular

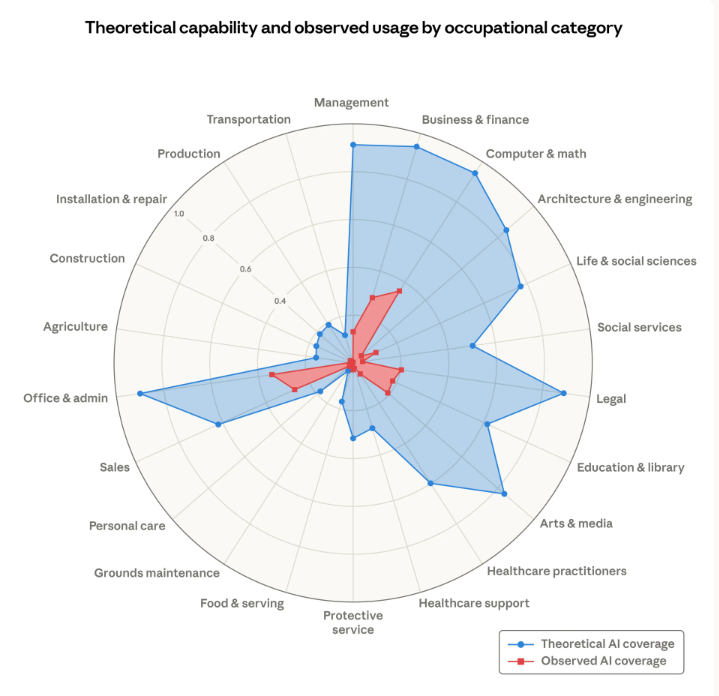

Un estudio de Anthropic publicado en marzo propuso una medición llamada “observed exposure”, que compara la capacidad teórica de los modelos de IA para intervenir en tareas laborales con el uso real observado en datos de Claude. La investigación advierte que todavía existe una distancia entre lo que la tecnología podría hacer y la forma en que está siendo usada en contextos profesionales.

En su estudio, Anthropic combinó tres fuentes de información: datos ocupacionales de O*NET, estimaciones previas sobre la capacidad teórica de los modelos para acelerar tareas laborales y datos reales de uso de Claude en contextos profesionales. Con eso construyó una métrica de “exposición observada” para comparar lo que la IA podría hacer con lo que efectivamente está haciendo.

Entre sus hallazgos, la compañía señaló que el uso real todavía está lejos de alcanzar el potencial técnico de los modelos; que la exposición se concentra sobre todo en ocupaciones de oficina, programación, análisis de datos, atención al cliente y tareas administrativas; y que la IA aparece tanto como herramienta de apoyo al trabajador como en usos más cercanos a la automatización directa. El estudio también advirtió que todavía no hay evidencia suficiente para traducir esa exposición en pérdidas laborales concluyentes, aunque sí observó señales tempranas que ameritan seguimiento, especialmente entre trabajadores jóvenes o de entrada en áreas más expuestas.

El contraste es relevante porque evita una lectura simplista del caso Amazon. El problema no sería únicamente que los empleados inflen métricas, sino que las empresas podrían estar confundiendo consumo de IA con transformación real. Usar más tokens no equivale necesariamente a producir mejor, ahorrar tiempo o rediseñar un flujo de trabajo.

En ese sentido, el caso apunta a una posible burbuja de adopción: organizaciones que necesitan demostrar avance acelerado en IA mediante indicadores internos, mientras sus equipos todavía aprenden cuándo usarla, cómo usarla y qué tareas justifican delegarse a un agente.

El caso Amazon muestra que la adopción de IA no solo depende de disponer de modelos o agentes internos. También requiere rediseñar procesos, capacitar trabajadores y definir métricas que midan valor, no solo actividad. Cuando el indicador central es el consumo de tokens, los empleados pueden aprender a optimizar la métrica antes que el trabajo.

La pregunta, entonces, no es solo cuántos trabajadores usan IA, sino cuántos la usan porque les permite hacer mejor su trabajo y cuántos la usan porque la empresa necesita demostrar que la transformación ya ocurrió.