Cuando una persona usa ChatGPT, Claude, Gemini u otro modelo de lenguaje, muchas veces no necesita programarlo ni entrenarlo de nuevo. Basta con darle algunos ejemplos dentro del mismo mensaje para que el sistema entienda qué debe hacer.

Por ejemplo: gato → animal,rosa → planta ymartillo →

herramientaNo basta con encontrar “dónde se ve” la tarea

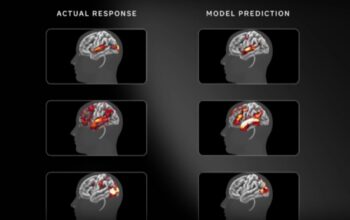

Hasta ahora, una parte de la investigación en interpretabilidad intentaba localizar representaciones internas dentro de los modelos. Es decir: buscar en qué capa o posición del modelo aparece información sobre la tarea que está realizando. El problema, según el estudio, es que detectar información no significa demostrar que esa información sea la causa del comportamiento del modelo.

Dicho de forma sencilla: que una señal aparezca en una parte del sistema no significa que esa parte sea la que controla la respuesta. Los autores lo probaron con una intervención directa. Tomaron activaciones internas del modelo, una especie de “estado interno” mientras procesa el texto, e intentaron reemplazar una sola posición para ver si eso cambiaba la tarea que el modelo estaba ejecutando.

El resultado fue llamativo: aunque podían detectar la tarea con alta precisión en ciertas posiciones internas, intervenir una sola posición produjo 0% de transferencia de tarea en las 28 capas de Llama-3.2-3B. En otras palabras: el modelo podía mostrar señales internas de la tarea, pero esas señales aisladas no bastaban para controlar lo que hacía.

La tarea parece estar distribuida

El avance del estudio apareció cuando los autores dejaron de intervenir una sola posición y empezaron a intervenir varias al mismo tiempo.

En lugar de cambiar un punto aislado, reemplazaron las activaciones correspondientes a los tokens de salida de los ejemplos. Es decir, no se enfocaron tanto en las palabras de entrada, sino en las respuestas de ejemplo que el modelo veía dentro del prompt.

Ahí sí hubo un cambio fuerte: la intervención en múltiples posiciones logró hasta 96% de transferencia en ciertos casos, especialmente alrededor de la capa 8 de un modelo de 28 capas, aproximadamente al 30% de profundidad de la red.

Esto sugiere que el modelo no guarda la tarea como una instrucción compacta del tipo: la tarea es clasificar.Más bien parece construir una especie de plantilla distribuida:

cuando la entrada tiene esta forma,

la salida debe tener esta otra forma,

con este tipo de relación,

y este formato de respuesta.Qué significa esto para usuarios normales

Para una persona que usa IA todos los días, el hallazgo ayuda a entender por qué los ejemplos dentro del prompt son tan importantes. Cuando le damos ejemplos a un modelo, no solo le estamos enseñando “el contenido” de una tarea. También le estamos enseñando una forma de responder: extensión, estructura, formato, tipo de transformación y patrón de salida.

Por eso un modelo puede comportarse distinto si le damos ejemplos breves, ejemplos largos, ejemplos con formato raro o ejemplos inconsistentes. El estudio incluso encontró que las salidas de los ejemplos importaban mucho más que las entradas: intervenir solo los tokens de salida logró resultados altos, mientras que intervenir solo los tokens de entrada no produjo transferencia.

La idea de fondo

La conclusión más importante no es que los modelos “no aprendan”. Al contrario: el estudio muestra que el aprendizaje dentro del prompt puede ser más complejo de lo que parecía. La IA no estaría tomando una instrucción y guardándola en un punto interno fácil de localizar. Estaría organizando el contexto como una estructura distribuida de respuesta.

Dicho de otra forma: Un modelo de lenguaje no aprende una tarea dentro del prompt como quien guarda una regla en una caja. La reconstruye como una forma de responder repartida entre los ejemplos.

Este hallazgo puede tener consecuencias para la forma en que se estudian, evalúan y controlan los modelos de IA.

Primero, porque cuestiona algunas técnicas de interpretabilidad que dicen haber encontrado “dónde” está una capacidad solo porque pueden detectarla internamente. Segundo, porque muestra que el diseño del prompt no es un detalle superficial. Los ejemplos, su orden, su formato y sus respuestas pueden afectar cómo el modelo entiende la tarea. Y tercero, porque para construir agentes de IA más confiables no basta con darles una instrucción general. También importa cómo se estructura la memoria, cómo se presentan los ejemplos y qué tipo de patrones de salida se les ofrece.

El estudio no cierra el debate, pero sí deja una advertencia clara: en los modelos de lenguaje, que algo pueda ser leído dentro de la red no significa que ese punto controle la conducta del modelo.