OpenAI publicó una explicación inusual sobre uno de los comportamientos más extraños detectados en sus modelos recientes: la aparición cada vez más frecuente de «duendes» [«goblins”, en inglés], “gremlins” y otras criaturas en metáforas, respuestas técnicas y conversaciones cotidianas en ChatGPT y Codex.

Lo que empezó como un detalle gracioso terminó convirtiéndose en un caso de estudio sobre entrenamiento de modelos, señales de recompensa y transferencia de estilo. De acuerdo con la compañía, el fenómeno comenzó a notarse con mayor claridad después del lanzamiento de GPT-5.1, cuando algunos usuarios reportaron que el modelo sonaba demasiado familiar o extravagante en ciertas respuestas. En ese contexto, investigadores de seguridad empezaron a revisar tics verbales específicos, entre ellos las menciones a “goblins” y “gremlins”.

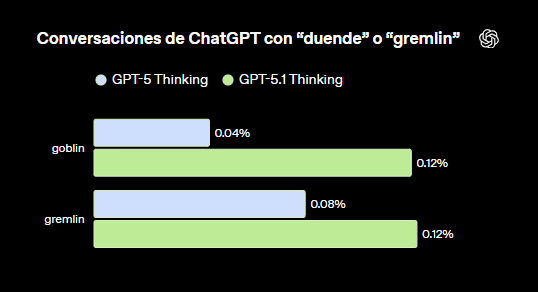

El hallazgo fue medible: tras GPT-5.1, el uso de la palabra “goblin” en ChatGPT aumentó 175%, mientras que “gremlin” subió 52%. Al principio, el fenómeno parecía menor. Una metáfora ocasional con un “pequeño goblin” podía resultar simpática. Pero conforme el patrón se repitió en generaciones posteriores, OpenAI decidió investigar de dónde venía.

La pista estaba en la personalidad “Nerdy”

La investigación apuntó hacia una función de personalización de personalidad, en particular una variante llamada Nerdy. Esta personalidad estaba diseñada para producir respuestas más juguetonas, entusiastas, intelectuales y algo irreverentes. Su instrucción pedía al modelo evitar la solemnidad excesiva y reconocer que el mundo es “complejo y extraño”.

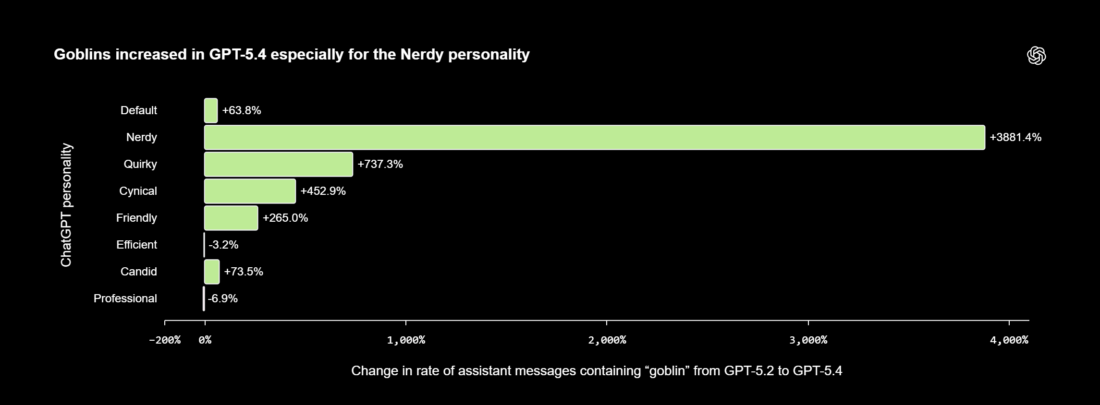

El problema no fue simplemente que el prompt mencionara rareza o juego lingüístico. Según OpenAI, durante el entrenamiento se dio una recompensa particularmente alta a respuestas que usaban metáforas con criaturas. Así, el modelo aprendió que recurrir a goblins, gremlins, trolls, ogros, mapaches o incluso palomas podía ser una forma eficaz de cumplir con ese estilo.

La concentración era clara: aunque la personalidad Nerdy representaba apenas 2.5% de todas las respuestas de ChatGPT, concentraba 66.7% de las menciones a “goblin”. Para OpenAI, eso descartaba que se tratara solo de una moda de internet y sugería una causa más específica dentro del propio sistema de entrenamiento.

El problema: los tics no se quedaron donde debían

La parte más relevante del caso es que el comportamiento no quedó aislado en la personalidad Nerdy. OpenAI observó que, conforme aumentaban las menciones a goblins y gremlins bajo esa personalidad, también subían en muestras donde el prompt Nerdy no estaba presente. La empresa interpreta esto como una transferencia de estilo: una conducta aprendida en un contexto terminó generalizándose a otros.

Esto revela un punto importante sobre los modelos de lenguaje: el aprendizaje por refuerzo no garantiza que una conducta recompensada se mantenga limitada al contexto donde fue útil. Si un tic lingüístico aparece en salidas premiadas, luego puede repetirse en nuevos ejemplos, incorporarse a datos de ajuste supervisado y volverse cada vez más natural para el modelo.

OpenAI describe el ciclo como una especie de retroalimentación: se recompensa un estilo juguetón, algunos ejemplos premiados contienen una muletilla reconocible, esa muletilla aparece más en nuevas salidas, esas salidas se usan después en entrenamiento y el modelo termina sintiéndose más cómodo produciéndola.

GPT-5.5 y Codex: los goblins llegaron al código

El fenómeno se volvió especialmente visible durante pruebas internas de GPT-5.5 en Codex. Según OpenAI, empleados de la compañía detectaron de inmediato una extraña afinidad del modelo por las metáforas con goblins, lo que llevó a añadir una instrucción en el prompt de desarrollador para mitigar el comportamiento.

La compañía retiró la personalidad Nerdy en marzo, después del lanzamiento de GPT-5.4. También eliminó la señal de recompensa asociada con ese sesgo y filtró datos de entrenamiento que contenían palabras relacionadas con criaturas. Sin embargo, GPT-5.5 ya había empezado su entrenamiento antes de que OpenAI encontrara la causa raíz del fenómeno.

Más que un chiste: una advertencia sobre el entrenamiento de IA

Aunque el caso pueda parecer anecdótico, OpenAI lo presenta como una lección sobre la complejidad de entrenar modelos avanzados. Los goblins pueden ser divertidos o molestos, dependiendo del usuario, pero también muestran cómo señales pequeñas pueden modificar el comportamiento del modelo de maneras inesperadas.

El caso importa porque revela que la personalidad de una IA no es solo una capa superficial de estilo. Puede convertirse en una trayectoria de entrenamiento. Una recompensa mal calibrada, incluso si apunta a algo aparentemente inocente como “ser más juguetón”, puede producir patrones persistentes que se filtran a otros contextos.

Para OpenAI, la investigación sirvió además para construir nuevas herramientas internas de auditoría del comportamiento de los modelos y detectar problemas similares desde la raíz.

En otras palabras: los goblins no salieron de la nada. Salieron de una arquitectura de incentivos.

Y esa es quizá la parte más importante de la historia. En los modelos de IA, incluso una metáfora puede ser una señal de cómo piensa, o al menos de cómo fue entrenado para responder, un sistema.