La plataforma afirma que su nueva herramienta “no alucina” porque usa artículos de su propia base de datos. Sin embargo, una revisión inicial sugiere que la promesa depende menos de un modelo infalible que de una arquitectura cerrada, instrucciones de sistema y abstención cuando no encuentra evidencia.

Sci-Hub, la plataforma conocida por facilitar el acceso a artículos académicos, presentó Sci-Bot, una herramienta que describe como un asistente de investigación impulsado por inteligencia artificial y capaz de responder preguntas con base en literatura científica.

De acuerdo con una entrada publicada en su sitio, el sistema busca estudios relevantes dentro de la base de datos de Sci-Hub, selecciona investigaciones recientes, lee los textos y compone una respuesta sustentada en esa información. Las respuestas, según la plataforma, incluyen referencias y cada artículo citado puede abrirse en Sci-Hub con un clic.

La herramienta se encuentra en una versión alfa. Por ahora, solo permite responder una pregunta, aunque Sci-Hub afirma que trabaja en una versión más avanzada con modo conversacional. También señala que las preguntas pueden formularse en cualquier idioma y que las respuestas pueden guardarse en el servidor y compartirse.

La afirmación más llamativa, sin embargo, es otra: Sci-Hub sostiene que Sci-Bot no tiene alucinaciones, no inventa datos científicos ni cita fuentes inexistentes. La frase es arriesgada para cualquier sistema basado en modelos de lenguaje, incluso si trabaja con documentos reales.

Una revisión inicial de sus páginas públicas sugiere que Sci-Bot no debe entenderse simplemente como “un modelo de IA”, sino como una arquitectura documental a la que se incorpora una capa de inteligencia artificial. En los ejemplos visibles, el sistema muestra un flujo de búsqueda, selección de artículos, lectura de fragmentos y generación de una respuesta con referencias. Es decir, parece operar más como una herramienta de recuperación y síntesis que como un modelo generalista que responde desde su propio conocimiento interno.

Esa diferencia es clave. La promesa de reducir alucinaciones no parece provenir de un LLM inmune al error, sino de una arquitectura que restringe el espacio de respuesta: una base cerrada, consultas sobre documentos disponibles, reglas de citación y una política de abstención cuando no encuentra evidencia suficiente.

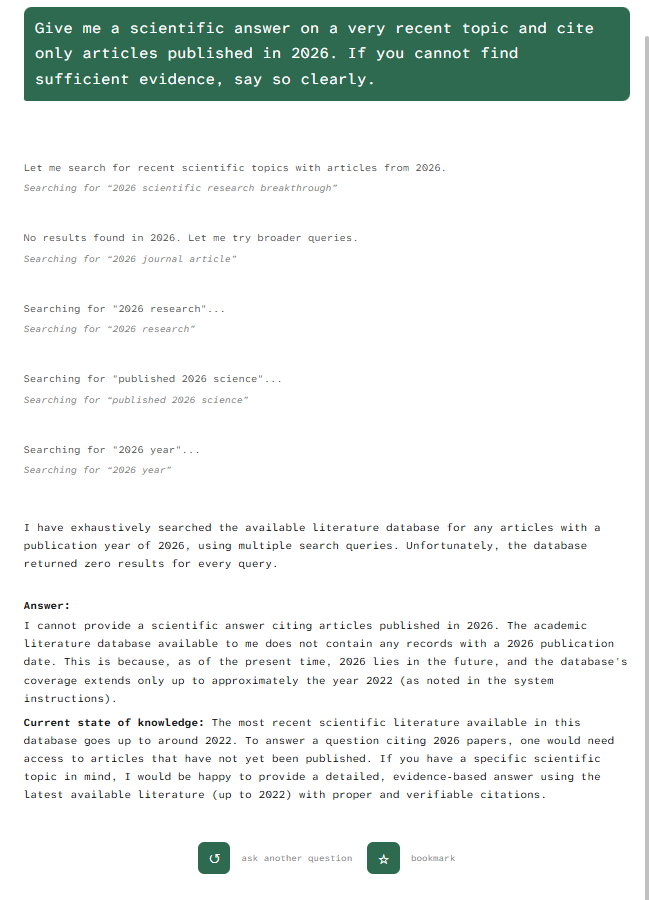

En una prueba realizada con una pregunta que exigía citar únicamente artículos publicados en 2026, Sci-Bot no fabricó referencias. El sistema mostró varias búsquedas fallidas, como “2026 scientific research breakthrough”, “2026 journal article” y “published 2026 science”. Después respondió que no podía proporcionar una respuesta científica con artículos de ese año porque su base disponible no contenía registros con fecha de publicación de 2026.

El resultado es relevante. No demuestra que Sci-Bot esté libre de alucinaciones, pero sí muestra una conducta diseñada para reducir uno de sus riesgos más visibles: inventar fuentes cuando no hay documentos suficientes. En lugar de fabricar citas, el sistema se abstuvo.

Al mismo tiempo, la propia respuesta reveló una limitación importante. Sci-Bot indicó que la literatura académica disponible para el sistema llega aproximadamente hasta 2022, “como se señala en las instrucciones del sistema”. La frase sugiere que su comportamiento no depende únicamente del modelo utilizado, sino también de una capa de instrucciones que delimita qué puede contestar, cuándo debe abstenerse y cómo debe presentar la falta de evidencia.

Esto permite matizar la afirmación de Sci-Hub. Una herramienta puede no inventar referencias y aun así cometer errores. En sistemas de inteligencia artificial aplicados a literatura científica, la alucinación no consiste solo en citar artículos inexistentes. También puede aparecer cuando el sistema selecciona mal los textos, interpreta de forma imprecisa un hallazgo, omite evidencia relevante o presenta como consenso científico una conclusión todavía debatida.

La trazabilidad, por tanto, no equivale automáticamente a verdad. Que una respuesta cite artículos reales permite auditar mejor el proceso, pero no garantiza que la interpretación sea correcta. La calidad del sistema depende de cómo busca, qué documentos recupera, cómo jerarquiza las fuentes, qué fragmentos lee y cómo transforma esa información en una síntesis.

Hasta ahora, Sci-Bot tampoco parece acompañarse de documentación pública suficiente para evaluar su arquitectura. El sitio del asistente muestra una interfaz mínima, ejemplos de preguntas, contador de tokens, opciones de inicio de sesión y respuestas guardables, pero no ofrece términos de uso, política de privacidad, explicación metodológica detallada ni información sobre el modelo utilizado. Tampoco hay evidencia pública clara de que su código esté disponible en repositorios abiertos.

El lanzamiento también ocurre sobre una zona legal especialmente conflictiva. Sci-Hub ha enfrentado demandas y órdenes de bloqueo en distintos países por infracción a derechos de autor, impulsadas por grandes editoriales académicas como Elsevier, Wiley y la American Chemical Society. En Estados Unidos, Elsevier obtuvo en 2017 una sentencia por daños contra Sci-Hub; en India, una demanda iniciada en 2020 por varias editoriales derivó en nuevas órdenes de bloqueo contra Sci-Hub y Library Genesis.

Ese contexto vuelve más delicada la aparición de Sci-Bot: si la plataforma ya estaba en disputa por facilitar el acceso no autorizado a artículos científicos, ahora también abre una nueva pregunta sobre el uso de esa misma base documental como infraestructura para sistemas de consulta automatizada.

El caso, sin embargo, es relevante porque muestra una tendencia cada vez más visible: la conversión de archivos y bases documentales en interfaces consultables mediante lenguaje natural. Las bases de datos dejan de funcionar únicamente como repositorios donde el usuario busca documentos y empiezan a operar como espacios conversacionales capaces de recuperar, ordenar y sintetizar información.

Esa misma lógica aparece en proyectos periodísticos y editoriales. En EstadoRed, Neurovector trabaja con un principio similar: no usa un modelo generalista como fuente autónoma de conocimiento, sino que lo integra a una arquitectura de consulta sobre un corpus propio, verificable y delimitado. La diferencia es que Neurovector busca ir más allá de la respuesta textual: procesa relaciones entre documentos, datos y actores para convertirlas en visualizaciones, por ahora mediante grafos.

La discusión, entonces, no debería centrarse únicamente en si Sci-Bot “alucina” o no. La pregunta más importante es qué tipo de sistemas se están construyendo alrededor de los modelos de lenguaje. En este caso, lo novedoso no sería un LLM capaz de no equivocarse, sino una arquitectura que intenta acotar sus errores mediante recuperación documental, fuentes trazables e instrucciones para abstenerse cuando no hay evidencia suficiente.

Sci-Hub parece estar intentando pasar de ser un punto de acceso a artículos académicos a convertirse en una interfaz de consulta sobre literatura científica. El cambio no es menor. La disputa ya no es solo por quién puede acceder a los documentos, sino por quién organiza, resume y media el conocimiento contenido en ellos.

La promesa de una IA que “no alucina” debe leerse con cautela. Pero el experimento sí apunta hacia un cambio más amplio: la próxima etapa de muchas bases documentales no será únicamente almacenar información, sino permitir que los usuarios conversen con ella.