La reconfiguración de Meta dejó esta semana una imagen curiosa. Mientras la compañía volvió a sembrar dudas sobre el destino de Horizon Worlds en VR —primero con señales de cierre y luego con una rectificación parcial de Andrew Bosworth para mantenerlo “en el futuro previsible” con soporte limitado—, un nuevo paper con Yann LeCun como coautor empujó justo la dirección contraria: menos apuesta por entornos virtuales como destino y más trabajo en sistemas capaces de modelar el mundo físico a partir de imágenes y video.

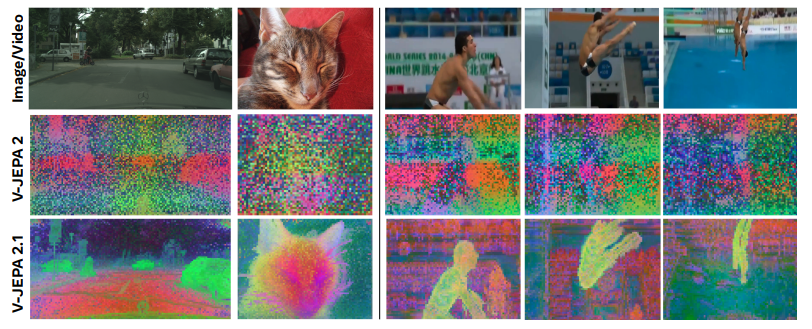

El paper, «V-JEPA 2.1: Unlocking Dense Features in Video Self-Supervised Learning«, presenta una familia de modelos auto-supervisados para aprender representaciones densas de alta calidad en imágenes y video sin perder comprensión global de la escena. Su idea central es mejorar una debilidad previa de la línea V-JEPA: preservar con más precisión la estructura espacial fina, el movimiento y la consistencia temporal, algo clave para tareas como segmentación, profundidad, navegación o manipulación robótica.

No se trata solo de otra iteración técnica. Los autores sostienen que las buenas features densas no emergen de forma confiable si la pérdida predictiva se aplica solo sobre regiones enmascaradas; por eso V-JEPA 2.1 extiende la pérdida a todos los tokens, incluidos los visibles, y añade deep self-supervision en capas intermedias. En términos simples, la apuesta es que una máquina no solo reconozca la escena “en grande”, sino que ancle cada parche del mundo en el espacio y en el tiempo con más fidelidad.

Los resultados que reporta el trabajo son lo bastante llamativos como para volver a poner a LeCun en el centro de la conversación. V-JEPA 2.1 obtuvo 7.71 mAP en Ego4D para anticipación de interacción a corto plazo, 40.8 Recall@5 en EPIC-KITCHENS para anticipación de acciones, mejoras en profundidad y segmentación, y además mostró una ganancia de 20% en éxito de grasping robótico frente a V-JEPA 2 AC. El paper también reporta planificación de navegación 10 veces más rápida que el enfoque previo basado en SD-VAE.

Ese movimiento no está aislado. Hace unos días, distintos medios reportaron que la nueva startup de LeCun, AMI Labs o Advanced Machine Intelligence, recaudó 1.03 mil millones de dólares y nombró a Alexandre LeBrun como CEO. La empresa fue presentada como una apuesta por world models, es decir, sistemas entrenados con datos del mundo real, como sensores y cámaras, en lugar de depender principalmente de instrucciones de texto. Según esa tesis, modelos así podrían anticipar mejor las consecuencias de sus acciones y operar con más seguridad en entornos físicos.

Visto junto, el contraste es difícil de ignorar. Durante años, Meta convirtió el metaverso en una promesa visible: un entorno digital para habitar, socializar y trabajar. La línea que LeCun viene defendiendo apunta a algo más ambicioso y menos vistoso: no construir solamente interfaces inmersivas ni chatbots elocuentes, sino sistemas que aprendan regularidades del mundo físico, predigan estados futuros y sirvan como base para percepción, planificación y acción. Esa lectura es una inferencia periodística, pero está fuertemente apoyada por el enfoque técnico de V-JEPA 2.1 y por la estrategia declarada de AMI.

Eso no significa que LeCun ya haya encontrado la ruta hacia una AGI funcional. Pero sí muestra con claridad cuál es su apuesta: ir más allá del paradigma centrado en texto que domina el ciclo actual de la IA y empujar arquitecturas que aprendan del video, la percepción y la interacción con el mundo. En ese sentido, la coincidencia de esta semana tiene algo simbólico: mientras una vieja fantasía tecnológica pierde forma, otra más profunda intenta ocupar su lugar.